一、Ollama 是什么?为什么最近总看到它

刷 AI 相关内容的时候,经常会看到有人提「Ollama」。它之所以最近出镜率高,原因很简单:

普通人想用上 AI,其实就两条路。

要么用付费的闭源产品,像 ChatGPT Plus、Claude Pro,一个月大概 20 美元,效果和速度都没得说,但数据要交到别人服务器上,总有人在意这个。

要么就用免费开源模型,比如 Meta 的 Llama、阿里的 Qwen、深度求索的 DeepSeek,模型不要钱、能力也不差,可麻烦在于——一般人根本跑不起来。

以前想跑这些开源模型,得自己装 Python、配 CUDA、折腾一堆依赖,还得去 Hugging Face 之类的地方找模型文件。光这一套就能劝退不少人。

Ollama 解决的就是这件事。

它把这一整套都打包好了。你可以继续用命令行玩,也可以像用 ChatGPT、DeepSeek 一样,打开桌面软件选个模型就开聊。装好之后,在应用里或命令行里都能自动下载模型,从下载到能对话,十来分钟很正常。

所以 Ollama 不是「又一个 AI」,而是一个让你在自家电脑上跑开源模型的工具。支持的系列很多:DeepSeek、Llama、Qwen、Gemma、Mistral、Phi 等,具体有哪些型号、什么版本,去 ollama.com/library 看一眼就清楚。

每个系列都有不同规模,从 1B 到几百 B 参数的都有,按你机器配置选就行。除了对话,还能看图、做 OCR,也支持 OpenAI 兼容的 API、用 Modelfile 自己做定制模型、Docker 部署等等,有需要再查文档就行。

二、装之前先想清楚三件事

Ollama 把本地部署的门槛拉低了很多,但硬件和预期还是得对上号,不然装完容易失望。

第一件:电脑配置直接决定你能跑多爽

Ollama 只是帮你把模型跑起来,不会给你「变」出本来没有的算力。

大致可以参考这个量级:

| 模型规模 | 内存需求 | 说明 |

|---|---|---|

| 1.5B–3B | 8GB | 可跑,响应尚可 |

| 7B–8B | 建议 16GB | 最好有独显 |

| 13B–14B | 需 32GB | 流畅运行建议有显卡 |

| 30B–70B | 64GB 起步 | 无高端显卡基本别想 |

上面说的是内存(RAM),不是硬盘。模型是吃内存的,不够就会用硬盘顶,那时候速度会掉得很明显。

显卡和显存:有 NVIDIA 卡、显存 6GB 以上,Ollama 会自动用 GPU,体感会快不少。纯 CPU 也能跑,只是会慢——同样是 7B 模型,有卡可能一秒十几个词,没卡可能就两三个。

显存吃紧的话,可以选带 q4、q8 的量化版本,7B 用 Q4 大概 5–6GB 显存就够,FP16 则要十几 GB。显存实在不够,Ollama 会把一部分算力放到 CPU 上(GPU offloading),能跑,但会变慢。这是物理上限,不是软件坑你。

第二件:开源模型和付费顶配仍有差距

很多人一听说「本地部署」就想:那是不是不用交月费了?是,但得接受一个现实:目前最强的开源模型,大概在 GPT-3.5 到 GPT-4 之间的水平,和 GPT-4 Turbo、Claude 3.5 Sonnet 那种还有距离。

复杂推理容易翻车、多轮聊着聊着忘前文、指令跟得没那么准、写东西时好时坏——这些是开源模型当下的通病,不是 Ollama 的锅。开源在追,但顶流闭源那边是几十亿美金在烧,短时间很难拉平。

第三件:多少还是要会一点「动手」

日常用桌面应用就够了,不用天天敲命令。但改模型保存路径、出问题时查日志,还是会碰到命令行、环境变量、报错信息。

能照着教程一步步来、报错会复制去搜一下,就够用。要是完全不想碰这些,电脑也只用来上上网,那本地部署可能不太适合你——直接订阅个付费 AI,对不少人来说反而更省事。

三、怎么装:从下载到第一次对话

还愿意试的话,按下面来就行。

Windows

Ollama 在 Windows 上是原生应用,支持 NVIDIA 和 AMD Radeon 显卡,不用装 WSL2。

系统要求(来自 官方文档):

- Windows 10 22H2 或更新版本(Home 或 Pro)

- NVIDIA 显卡需驱动 452.39 或更新;AMD 显卡需从 AMD 官网 安装 Radeon 驱动

安装步骤:

- 打开 ollama.com/download,下载 Windows 版

OllamaSetup.exe。 - 双击安装包,按提示完成安装。默认安装到当前用户目录,不需要管理员权限;若想安装到其他位置,可在命令行执行:

.\OllamaSetup.exe /DIR="d:\some\location" - 安装完成后 Ollama 会在后台运行,在 cmd、PowerShell 或任意终端中可直接使用

ollama命令。 - 验证:打开命令提示符或 PowerShell,输入

ollama -v,若显示版本号则安装成功。

macOS 安装

系统要求:Apple M 系列(支持 CPU/GPU)或 x86(仅 CPU);macOS Sonoma(v14)或更新。

推荐方式:从 ollama.com/download 下载 macOS 版 .dmg,打开后将 Ollama 拖入「应用程序」文件夹。首次启动时,若检测到系统 PATH 中还没有 ollama 命令行,会提示是否安装到 /usr/local/bin,选择允许即可在终端使用 ollama。

下载并运行第一个模型

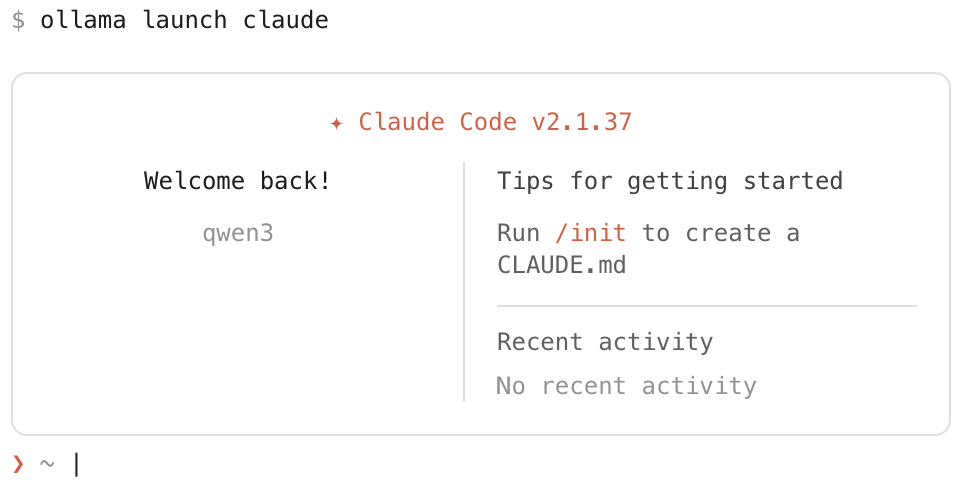

装好后,在命令行输入:

ollama run deepseek-r1:1.5b这会下载约 15 亿参数的 DeepSeek 模型,体积约 1.1GB。下载时间取决于网速,一般几分钟到十几分钟。

下载完成后会自动进入对话模式,你会看到 >>> 提示符,此时即可输入内容与模型对话。输入 /exit 可退出对话。

模型放哪儿最好先想好

默认会下到用户目录,Windows 上多半是 C 盘。一个模型小则 1GB,大则上百 GB,系统盘很容易爆。建议装完就把模型保存路径改到别的盘或外置硬盘,改法各系统不一样,查一下官方文档里对应平台就行。

四、日常怎么用

常用命令

和 官方 CLI 文档 一致,记这几个就够:

| 命令 | 作用 |

|---|---|

ollama | 直接运行可打开交互式菜单:方向键选择、回车启动、→ 切换模型、Esc 退出 |

ollama run <模型名> | 运行模型并进入对话模式 |

ollama pull <模型名> | 只下载模型,不运行 |

ollama ls | 查看本地已下载的模型 |

ollama rm <模型名> | 删除本地模型 |

ollama ps | 查看正在运行的模型及占用(GPU/CPU、上下文长度等) |

ollama stop <模型名> | 停止运行中的模型 |

ollama serve | 手动启动 Ollama 服务(桌面版一般自动后台运行,无需单独执行) |

要输入一大段字时,用三个双引号 """ 包住再回车,方便粘贴。

模型怎么选

完整列表在 ollama.com/library,每个模型有不同尺寸(tag)。刚开始可以试试:deepseek-r1:1.5b(最小,8GB 内存就能跑)、phi3(微软的,3.8b 那档,16GB 够用)、qwen2.5:7b(阿里通义千问开源版,中文不错)、gemma3(官方示例常用,多尺寸)。

模型名后面加 :tag 可以指定版本,比如 qwen3:8b,具体 tag 看官网。新手先用默认 latest,玩熟了再折腾量化之类。

想看图、做 OCR:除了纯文字模型,还有视觉模型,能识别图片、做 OCR、读图表,比如 llama3.2-vision、llava、qwen2.5vl,在命令行或 API 里传图片路径就行。

这类会更大、更吃显存,选的时候看下 Library 说明。

写代码调:Ollama 的 API 和 OpenAI 兼容,服务在 http://localhost:11434。你原来用 OpenAI SDK 的话,把 base_url 改成 http://localhost:11434/v1,api_key 随便填(比如 ollama),模型名换成你本地拉过的,就能切到本地跑。

做原型、测试、离线开发都很方便。

自己做定制模型:想固定人设、调温度或上下文长度,可以用 Modelfile。写一个文件,里面对应 FROM 基础模型、SYSTEM 提示、PARAMETER 等,然后 ollama create 我的模型 -f Modelfile,之后 ollama run 我的模型 就行。

要分享就发 Modelfile 给别人,对方 ollama create 一下就能用。

长对话:调上下文长度

默认上下文长度会按你显存来(显存大就给得长)。要做长上下文的事(比如网页检索、编程助手),建议至少开到 64000 token。

用桌面应用的话,在设置里用滑块调;用命令行或自建服务,要在启动服务时设环境变量:OLLAMA_CONTEXT_LENGTH=64000 ollama serve(不是 run 的时候)。开太大显存扛不住的话,会有一部分算力退到 CPU,用 ollama ps 看 PROCESSOR 那列是不是 100% GPU 就知道了。

出问题怎么查

环境变量有哪些可以 ollama serve --help 看。日志位置:Windows 在 %LOCALAPPDATA%\Ollama、%HOMEPATH%\.ollama,Win+R 输 explorer %LOCALAPPDATA%\Ollama 能打开;macOS 在 ~/.ollama/logs。

显存爆了(OOM):换小一点的模型或 q4/q8 量化版,一次只跑一个模型,必要时设 OLLAMA_NUM_PARALLEL=1。

连不上或访问不了:先确认 Ollama 在跑(看托盘或 ollama ps);要从别的机器访问就设 OLLAMA_HOST=0.0.0.0:11434(注意安全);用代理的话只设 HTTPS_PROXY,别乱设 HTTP_PROXY。

GPU 没被用上:Windows 上看看驱动是不是够新(NVIDIA 452.39+),用 ollama ps 看 PROCESSOR,要是显示 CPU 就去日志里搜显卡相关报错。

五、什么人适合用,什么人不适合

对隐私特别在意、不想把公司文件/合同/稿子/病历之类传上网的,本地跑模型是刚需,对话全在你机器里,数据不出门。

做开发的想调 AI 接口又不想每次调用都烧钱,本地拉一个模型,Ollama 提供 OpenAI 兼容 API,改个 base_url 就能切过来,随便测。出差、飞机上、没网的地方,有个本地 AI 也能顶一阵。

还有一类是单纯想搞懂「AI 到底怎么跑的」——Ollama 上手快,折腾一小时就能摸个大概。想搞私有知识库的,配合 Dify、MaxKB、AnythingLLM 之类,把文档喂给本地模型做问答,数据也不用出去。需要在本机看图、OCR、读表格的,可以跑视觉模型,同样不出本机。

反过来,如果你只是想日常写写东西、问问题、省事用,不打算折腾,那直接用 ChatGPT 或国内付费 AI 更合适,本地模型在能力和体验上还有差距。

机器太老(比如 2018 年前的本子、4GB 内存、机械硬盘),跑是能跑,但会慢到你怀疑人生,不如直接用网页版。完全不想碰命令行、改路径、查报错的,订阅付费服务更省心。

对推理难度、多模态效果、响应速度要求特别高的,目前还是顶尖付费 AI 更强,本地多模态能做看图做 OCR,但和闭源旗舰比还有距离。

几个常见误解

「Ollama 等于免费 ChatGPT」——不是,它是跑开源模型的工具,模型能力跟 GPT-4 不是一档。

「装好就拥有自己的顶配 AI」——算拥有,但强不强看你机器和选的模型,不是装完自动变强。「随便什么电脑都能跑得爽」——能跑和好用两码事,低配上很容易后悔。

「本地完全替代付费 AI」——目前还不行,复杂推理、多模态效果、速度上顶尖闭源还是领先。「本地不能看图、做 OCR」——可以,有视觉模型,传图、OCR、图表识别都行,只是效果比闭源旗舰差一截。

六、真要试的话,几条实用建议

别一上来就拉 7B、8B,先用 1.5B 跑通、感受一下,有意思再往上加。显存或内存吃紧就优先选带 q4、q8 这类量化 tag 的,体积和占用都小不少。

装完最好先把模型保存路径改到别的盘或外置硬盘,尤其 Windows,C 盘爆了再挪很烦。平时用系统托盘或菜单栏里的 Ollama 应用就够了,不用天天开命令行。

本地模型有上下文长度限制,聊太长会忘,重要内容记得自己存一份。出问题先把报错复制去搜,用的人多,大部分情况都能搜到解法。

七、小结

Ollama 好用,但别指望它万能。你在意隐私、想自己折腾技术、或者需要本地调 API,用它很合适。

你只是想要个顺手 AI 助手、不想折腾,那直接订阅付费 AI 更省事,一个月 20 美元买的是省心。选哪条路看你需求,没有谁比谁高级。

发表回复